Az Anthropic mesterséges intelligencia vállalat közölte, hogy nem fog eleget tenni az Egyesült Államok Védelmi Minisztériumának azon kérésének, hogy lazítsák az MI-rendszereiben alkalmazott biztonsági korlátozásokat, és azzal indokolta a döntését, hogy aggasztják a tömeges megfigyelés és az autonóm fegyverek.

Csütörtöki nyilatkozatában Dario Amodei vezérigazgató bejelentette, hogy a vállalat ellenezné, ha a Claude nevű MI-modelljét „tömeges belföldi megfigyelésre” vagy „teljesen autonóm fegyverekre” használnák.

Kifejtette, hogy a fejlett MI-rendszerek még nem elég megbízhatóak ahhoz, hogy emberi felügyelet nélkül működtessenek ilyen fegyvereket, és olyan biztonsági intézkedésekre van szükség, amelyek a mai körülmények között nem állnak rendelkezésre.

Amodei emellett figyelmeztetett arra, hogy az MI támogathatja a nemzetbiztonságot, de a széles körű, MI-alapú megfigyelés veszélyeztetheti a polgári szabadságjogokat..

Az Anthropic és a Pentagon már hetek óta tárgyalásokat folytat.

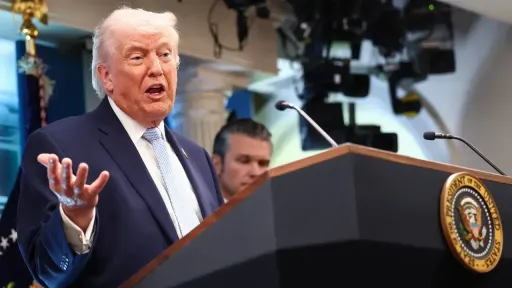

A Trump-kormányzat az Anthropic céget azzal fenyegette, hogy alkalmazza a Védelmi Termelési Törvényt, amely felhatalmazza a kormányt arra, hogy a vállalatokat a nemzetvédelmi igények előtérbe helyezésére kényszerítse, és megfontolta, hogy az Anthropicot „ellátási lánc kockázataként” minősítse. Egy ilyen besorolás megakadályozná a Védelmi Minisztérium beszállítóit abban, hogy a vállalat szoftverét használják.

Az Axios jelentése szerint a Pentagon megkezdte a lépéseket ennek a besorolásnak a megvalósítására, és arra kérte a Boeinget és a Lockheed Martint, hogy részletezzék a Claude-hoz való függőségüket.

Sean Parnell, a Pentagon szóvivője tagadta, hogy a tárca a mesterséges intelligenciát törvénytelen megfigyelésre vagy emberi felügyelet nélküli teljesen autonóm fegyverekre használná.

Parnell egy X-bejegyzésben azt írta, hogy a Pentagon az Anthropic modelljét „minden törvényes célra” kívánja használni, és nem fogják engedélyezni, hogy egy magánvállalat operatív döntéseket hozzon.